OpenAI presenta una nueva protección de ‘Contacto de Confianza’ para casos de posible autolesión

OpenAI ha lanzado una nueva función de "Contacto de Confianza" en ChatGPT destinada a abordar conversaciones que puedan involucrar autolesiones. Esta protección opcional alerta a un contacto designado si OpenAI determina que un usuario puede estar en grave riesgo de seguridad.

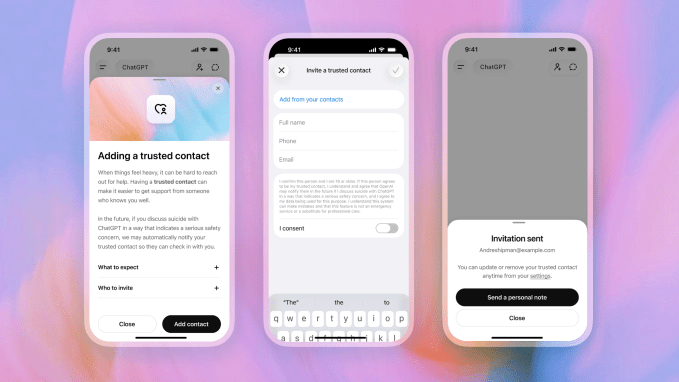

El jueves, OpenAI anunció una nueva función llamada Contacto de confianza, diseñada para alertar a un tercero de confianza si se mencionan ideas de autolesión en una conversación. La función permite que un usuario adulto de ChatGPT designe a otra persona como contacto de confianza dentro de su cuenta, como un amigo o familiar.

En los casos en que una conversación pueda derivar hacia la autolesión, OpenAI animará al usuario a ponerse en contacto con esa persona. También envía una alerta automática al contacto, alentándolo a comunicarse con el usuario.

Antecedentes y presión legal

OpenAI ha enfrentado una ola de demandas por parte de las familias de personas que se han suicidado tras hablar con su chatbot. En varios casos, las familias alegan que ChatGPT animó a su ser querido a quitarse la vida — o incluso les ayudó a planearlo.

Cómo funciona Contacto de confianza

Actualmente, OpenAI utiliza una combinación de automatización y revisión humana para gestionar incidentes potencialmente dañinos. Ciertos desencadenantes en las conversaciones alertan al sistema de la empresa sobre posibles ideas suicidas, lo que luego transmite la información a un equipo humano de seguridad. La empresa afirma que cada vez que recibe este tipo de notificación, el incidente es revisado por una persona.

“Nos esforzamos por revisar estas notificaciones de seguridad en menos de una hora”, afirma la empresa.

Si el equipo interno de OpenAI determina que la situación representa un riesgo grave para la seguridad, ChatGPT envía una alerta al contacto de confianza — ya sea por correo electrónico, mensaje de texto o notificación dentro de la aplicación. La alerta está diseñada para ser breve y animar al contacto a comunicarse con la persona en cuestión. No incluye información detallada sobre lo que se estaba discutiendo, como una forma de proteger la privacidad del usuario, según la empresa.

Medidas relacionadas y limitaciones

La función Contacto de confianza sigue a las medidas de protección que la empresa introdujo el pasado septiembre, las cuales otorgaron a los padres supervisión sobre las cuentas de sus hijos adolescentes, incluida la recepción de notificaciones de seguridad si el sistema de OpenAI considera que su hijo enfrenta un “riesgo grave para la seguridad”. ChatGPT también ha incluido alertas automáticas que animan a los usuarios a buscar servicios profesionales de salud si una conversación se orienta hacia la autolesión.

Contacto de confianza es opcional y, incluso si se activa en una cuenta determinada, cualquier usuario puede mantener múltiples cuentas de ChatGPT. Los controles parentales de OpenAI también son opcionales, lo que presenta una limitación similar.

“Contacto de confianza forma parte del esfuerzo más amplio de OpenAI por desarrollar sistemas de IA que ayuden a las personas en momentos difíciles”, escribió la empresa en su publicación de anuncio. “Seguiremos trabajando con clínicos, investigadores y responsables de políticas públicas para mejorar la forma en que los sistemas de IA responden cuando las personas pueden estar experimentando angustia.”