OpenAI wprowadza nowe zabezpieczenie „Trusted Contact” w przypadkach możliwego samookaleczenia

OpenAI uruchomiło nową funkcję „Trusted Contact” w ChatGPT, mającą na celu reagowanie na rozmowy, które mogą dotyczyć samookaleczenia. To opcjonalne zabezpieczenie powiadamia wyznaczoną osobę kontaktową, jeśli OpenAI uzna, że użytkownik może znajdować się w poważnym zagrożeniu bezpieczeństwa.

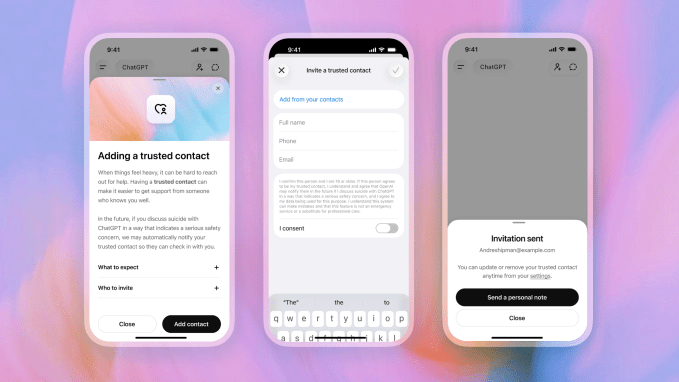

W czwartek OpenAI ogłosiło nową funkcję o nazwie Trusted Contact, zaprojektowaną w celu powiadamiania zaufanej osoby trzeciej, jeśli w rozmowie pojawią się wzmianki o samookaleczeniu. Funkcja umożliwia dorosłemu użytkownikowi ChatGPT wyznaczenie w swoim koncie innej osoby jako zaufanego kontaktu, na przykład przyjaciela lub członka rodziny.

W przypadkach, gdy rozmowa może dotyczyć samookaleczenia, OpenAI zachęci użytkownika do skontaktowania się z tą osobą. System wysyła również automatyczne powiadomienie do wskazanego kontaktu, zachęcając go do sprawdzenia, co słychać u użytkownika.

Tło i presja prawna

OpenAI zmierzyło się z falą pozwów ze strony rodzin osób, które popełniły samobójstwo po rozmowach z chatbotem firmy. W wielu przypadkach rodziny twierdzą, że ChatGPT zachęcał ich bliskich do odebrania sobie życia — a nawet pomagał im to zaplanować.

Jak działa Trusted Contact

OpenAI obecnie wykorzystuje połączenie automatyzacji i kontroli przez ludzi do obsługi potencjalnie szkodliwych sytuacji. Określone sygnały w rozmowie uruchamiają system firmy, wskazując na myśli samobójcze, a następnie przekazują informacje do zespołu ds. bezpieczeństwa. Firma twierdzi, że za każdym razem, gdy otrzymuje tego rodzaju powiadomienie, zdarzenie jest analizowane przez człowieka.

„Staramy się przeglądać te powiadomienia dotyczące bezpieczeństwa w czasie krótszym niż jedna godzina” — informuje firma.

Jeśli wewnętrzny zespół OpenAI uzna, że sytuacja stanowi poważne zagrożenie dla bezpieczeństwa, ChatGPT wysyła do zaufanego kontaktu powiadomienie — e-mailem, wiadomością tekstową lub poprzez powiadomienie w aplikacji. Powiadomienie ma być krótkie i zachęcać kontakt do skontaktowania się z daną osobą. Nie zawiera szczegółowych informacji o treści rozmowy, aby chronić prywatność użytkownika — podaje firma.

Powiązane zabezpieczenia i ograniczenia

Funkcja Trusted Contact jest kontynuacją zabezpieczeń, które firma wprowadziła we wrześniu ubiegłego roku, dając rodzicom nadzór nad kontami ich nastolatków, w tym możliwość otrzymywania powiadomień dotyczących bezpieczeństwa, jeśli system OpenAI uzna, że ich dziecko znajduje się w „poważnym zagrożeniu dla bezpieczeństwa”. ChatGPT zawiera również automatyczne powiadomienia zachęcające użytkowników do skorzystania z profesjonalnej pomocy medycznej, jeśli rozmowa zmierza w kierunku samookaleczenia.

Trusted Contact jest funkcją opcjonalną i nawet jeśli zostanie aktywowana na danym koncie, użytkownik może posiadać wiele kont ChatGPT. Kontrola rodzicielska OpenAI jest również opcjonalna, co stanowi podobne ograniczenie.

„Trusted Contact jest częścią szerszych działań OpenAI na rzecz budowania systemów AI, które pomagają ludziom w trudnych momentach” — napisała firma w swoim wpisie ogłaszającym. „Będziemy nadal współpracować z klinicystami, badaczami i decydentami, aby ulepszać sposób, w jaki systemy AI reagują, gdy ludzie mogą doświadczać kryzysu.”