Nowy model Images 2.0 w ChatGPT zaskakująco dobrze generuje tekst

Nowy model ChatGPT Images 2.0 od OpenAI pokazuje znaczące usprawnienia w renderowaniu czytelnego tekstu w obrazach generowanych przez AI. Model potrafi tworzyć szczegółowe wizualizacje, materiały marketingowe, a nawet wielopanelowe komiksy, oferując lepsze wykonywanie poleceń i obsługę tekstu w wielu językach.

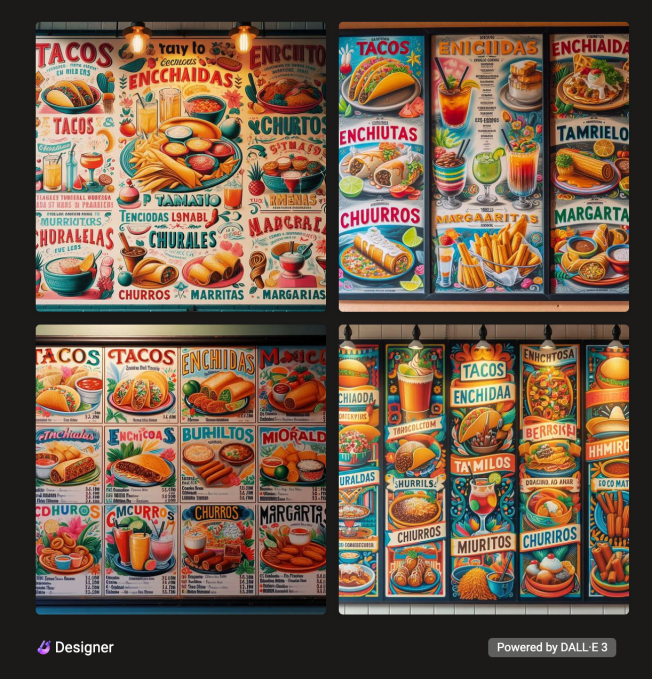

Kiedyś łatwo było odróżnić obrazy tworzone przez ludzi od tych generowanych przez AI. Jeszcze dwa lata temu nie dało się użyć modeli obrazu do stworzenia menu dla meksykańskiej restauracji bez wymyślania nowych kulinarnych „specjałów”, takich jak „enchuita”, „churiros”, „burrto” i „margartas”.

Dziś, gdy poprosi się o menu z meksykańskimi potrawami, nowy model OpenAI ChatGPT Images 2.0 tworzy coś, co mogłoby zostać natychmiast użyte w restauracji bez wzbudzania podejrzeń klientów. (Choć ceviche w cenie 13,50 USD może rodzić pytania dotyczące ryby).

Źródło obrazu: ChatGPT Images 2.0

Dla porównania, oto wynik wygenerowany przez DALL-E 3 dwa lata temu, kiedy ChatGPT nie obsługiwał jeszcze generowania obrazów:

Źródło obrazu: Microsoft Designer (DALL-E 3)

Dlaczego modele obrazów AI miały problemy z tekstem

Generatory obrazów AI historycznie miały trudności z poprawną pisownią, ponieważ zazwyczaj opierały się na modelach dyfuzyjnych, które rekonstruują obrazy z szumu.

„Modele dyfuzyjne […] rekonstruują dane wejściowe” — powiedział w 2024 roku serwisowi TechCrunch Asmelash Teka Hadgu, założyciel i CEO Lesan AI. „Możemy założyć, że napisy na obrazie stanowią bardzo, bardzo małą część całości, więc generator obrazu uczy się wzorców obejmujących większą liczbę pikseli.”

Od tego czasu badacze zaczęli eksplorować inne mechanizmy generowania obrazów, takie jak modele autoregresyjne, które przewidują, jak powinien wyglądać obraz, i działają bardziej jak duże modele językowe (LLM).

Podczas konferencji prasowej OpenAI odmówiło sprecyzowania, jaki typ modelu napędza ChatGPT Images 2.0.

Nowe możliwości w Images 2.0

OpenAI twierdzi, że nowy model ma „zdolności rozumowania”, co umożliwia mu przeszukiwanie internetu, generowanie wielu obrazów na podstawie jednego polecenia oraz podwójne sprawdzanie swoich wyników. Dzięki temu Images 2.0 może tworzyć materiały marketingowe w różnych rozmiarach, a nawet wielopanelowe komiksy.

Firma podaje również, że model lepiej radzi sobie z renderowaniem tekstów w alfabetach niełacińskich, w językach takich jak japoński, koreański, hindi i bengalski. Jego zakres wiedzy obejmuje dane do grudnia 2025 roku, co może wpływać na dokładność odpowiedzi na polecenia dotyczące niedawnych wydarzeń.

„Images 2.0 wprowadza bezprecedensowy poziom szczegółowości i wierności w tworzeniu obrazów. Potrafi nie tylko konceptualizować bardziej zaawansowane obrazy, ale także skutecznie urzeczywistniać tę wizję, podążając za instrukcjami, zachowując wymagane detale i renderując drobne elementy, które często sprawiają trudność modelom obrazowym: mały tekst, ikonografię, elementy interfejsu użytkownika, gęste kompozycje oraz subtelne ograniczenia stylistyczne — wszystko w rozdzielczości do 2K” — poinformowało OpenAI w komunikacie prasowym.

Choć generowanie obrazów nie jest tak natychmiastowe jak wpisywanie pytania w ChatGPT, stworzenie czegoś złożonego, takiego jak wielopanelowy komiks, zajmuje tylko kilka minut.

Od wtorku wszyscy użytkownicy ChatGPT i Codex będą mieli dostęp do Images 2.0, przy czym użytkownicy płatni będą mogli generować bardziej zaawansowane rezultaty. OpenAI udostępni również API gpt-image-2, z cenami zależnymi od jakości i rozdzielczości wygenerowanych wyników.