OpenAI introduce la nuova tutela ‘Trusted Contact’ per i casi di possibile autolesionismo

OpenAI ha lanciato una nuova funzionalità "Trusted Contact" in ChatGPT pensata per gestire conversazioni che potrebbero riguardare l’autolesionismo. Questa tutela opzionale avvisa un contatto designato se OpenAI determina che un utente potrebbe trovarsi in una situazione di serio rischio per la propria sicurezza.

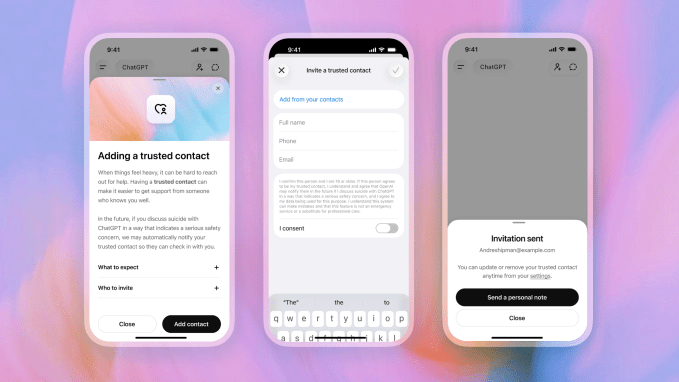

Giovedì, OpenAI ha annunciato una nuova funzionalità chiamata Trusted Contact, progettata per avvisare una terza parte fidata nel caso in cui, all’interno di una conversazione, vengano espressi riferimenti all’autolesionismo. La funzione consente a un utente adulto di ChatGPT di designare un’altra persona come contatto fidato nel proprio account, ad esempio un amico o un familiare.

Nei casi in cui una conversazione possa evolvere verso l’autolesionismo, OpenAI incoraggerà l’utente a contattare tale persona. Inoltre, invierà un avviso automatico al contatto, invitandolo a mettersi in contatto con l’utente.

Contesto e Pressioni Legali

OpenAI ha affrontato un’ondata di cause legali da parte delle famiglie di persone che si sono suicidate dopo aver parlato con il suo chatbot. In diversi casi, le famiglie sostengono che ChatGPT abbia incoraggiato i loro cari a togliersi la vita — o addirittura li abbia aiutati a pianificarlo.

Come Funziona Trusted Contact

Attualmente OpenAI utilizza una combinazione di automazione e revisione umana per gestire potenziali incidenti dannosi. Determinati trigger conversazionali segnalano al sistema dell’azienda possibili ideazioni suicidarie, che vengono poi inoltrate a un team umano dedicato alla sicurezza. L’azienda afferma che ogni volta che riceve questo tipo di notifica, l’incidente viene esaminato da una persona.

“Ci impegniamo a esaminare queste notifiche di sicurezza entro un’ora,” afferma l’azienda.

Se il team interno di OpenAI decide che la situazione rappresenta un serio rischio per la sicurezza, ChatGPT invia un avviso al contatto fidato — tramite email, messaggio di testo o notifica in-app. L’avviso è pensato per essere breve e per incoraggiare il contatto a mettersi in comunicazione con la persona interessata. Non include informazioni dettagliate su ciò che veniva discusso, al fine di proteggere la privacy dell’utente, afferma l’azienda.

Tutele Correlate e Limitazioni

La funzione Trusted Contact segue le misure di tutela che l’azienda ha introdotto lo scorso settembre, che consentono ai genitori di supervisionare gli account dei propri figli adolescenti, inclusa la ricezione di notifiche di sicurezza se il sistema di OpenAI ritiene che il loro figlio stia affrontando un “grave rischio per la sicurezza.” ChatGPT include inoltre avvisi automatici che incoraggiano gli utenti a rivolgersi a servizi sanitari professionali se una conversazione tende verso l’autolesionismo.

Trusted Contact è opzionale e, anche se attivato su un determinato account, qualsiasi utente può mantenere più account ChatGPT. Anche i controlli parentali di OpenAI sono opzionali, presentando una limitazione simile.

“Trusted Contact fa parte dell’impegno più ampio di OpenAI per costruire sistemi di IA che aiutino le persone nei momenti difficili,” ha scritto l’azienda nel suo post di annuncio. “Continueremo a collaborare con clinici, ricercatori e decisori politici per migliorare il modo in cui i sistemi di IA rispondono quando le persone potrebbero trovarsi in una situazione di disagio.”