OpenAI présente une nouvelle mesure de protection « Contact de confiance » pour les cas de possible automutilation

OpenAI a lancé une nouvelle fonctionnalité « Contact de confiance » dans ChatGPT visant à traiter les conversations pouvant impliquer une automutilation. Cette mesure de protection optionnelle alerte un contact désigné si OpenAI estime qu’un utilisateur peut être exposé à un risque sérieux pour sa sécurité.

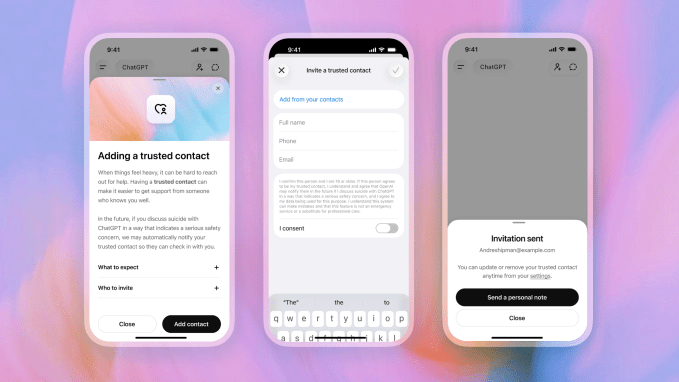

Jeudi, OpenAI a annoncé une nouvelle fonctionnalité appelée Contact de confiance, conçue pour alerter un tiers de confiance si des propos liés à l’automutilation sont exprimés au cours d’une conversation. Cette fonctionnalité permet à un utilisateur adulte de ChatGPT de désigner une autre personne comme contact de confiance dans son compte, par exemple un ami ou un membre de la famille.

Dans les cas où une conversation pourrait s’orienter vers l’automutilation, OpenAI encouragera l’utilisateur à contacter cette personne. Un message d’alerte automatisé est également envoyé au contact, l’encourageant à prendre des nouvelles de l’utilisateur.

Contexte et pression juridique

OpenAI a fait face à une vague de poursuites judiciaires de la part des familles de personnes qui se sont suicidées après avoir échangé avec son chatbot. Dans plusieurs cas, les familles affirment que ChatGPT a encouragé leur proche à se suicider — voire les a aidés à planifier l’acte.

Fonctionnement du Contact de confiance

OpenAI utilise actuellement une combinaison d’automatisation et de révision humaine pour traiter les incidents potentiellement dangereux. Certains déclencheurs conversationnels alertent le système de l’entreprise en cas d’idées suicidaires, qui transmet ensuite l’information à une équipe humaine chargée de la sécurité. L’entreprise affirme que chaque fois qu’elle reçoit ce type de notification, l’incident est examiné par une personne.

« Nous nous efforçons d’examiner ces notifications de sécurité en moins d’une heure », indique l’entreprise.

Si l’équipe interne d’OpenAI décide que la situation représente un risque grave pour la sécurité, ChatGPT envoie une alerte au contact de confiance — par e-mail, message texte ou notification dans l’application. L’alerte est conçue pour être brève et pour encourager le contact à prendre des nouvelles de la personne concernée. Elle ne comprend pas d’informations détaillées sur le contenu de la conversation, afin de protéger la vie privée de l’utilisateur, précise l’entreprise.

Mesures de protection associées et limites

La fonctionnalité Contact de confiance fait suite aux mesures de protection que l’entreprise a introduites en septembre dernier, donnant aux parents un droit de regard sur les comptes de leurs adolescents, notamment en recevant des notifications de sécurité si le système d’OpenAI estime que leur enfant fait face à un « risque grave pour sa sécurité ». ChatGPT inclut également des alertes automatisées encourageant les utilisateurs à consulter des services de santé professionnels si une conversation s’oriente vers l’automutilation.

Le Contact de confiance est facultatif et, même s’il est activé sur un compte particulier, tout utilisateur peut conserver plusieurs comptes ChatGPT. Les contrôles parentaux d’OpenAI sont également facultatifs, ce qui présente une limite similaire.

« Le Contact de confiance s’inscrit dans l’effort plus large d’OpenAI visant à créer des systèmes d’IA qui aident les personnes dans les moments difficiles », a écrit l’entreprise dans son billet d’annonce. « Nous continuerons à travailler avec des cliniciens, des chercheurs et des décideurs publics afin d’améliorer la manière dont les systèmes d’IA réagissent lorsque des personnes peuvent être en situation de détresse. »