Le nouveau modèle Images 2.0 de ChatGPT est étonnamment performant pour générer du texte

Le nouveau modèle ChatGPT Images 2.0 d’OpenAI démontre des améliorations majeures dans le rendu de texte lisible au sein d’images générées par IA. Le modèle peut créer des visuels détaillés, des supports marketing et même des bandes dessinées à plusieurs panneaux, avec un meilleur respect des instructions et une prise en charge du texte multilingue.

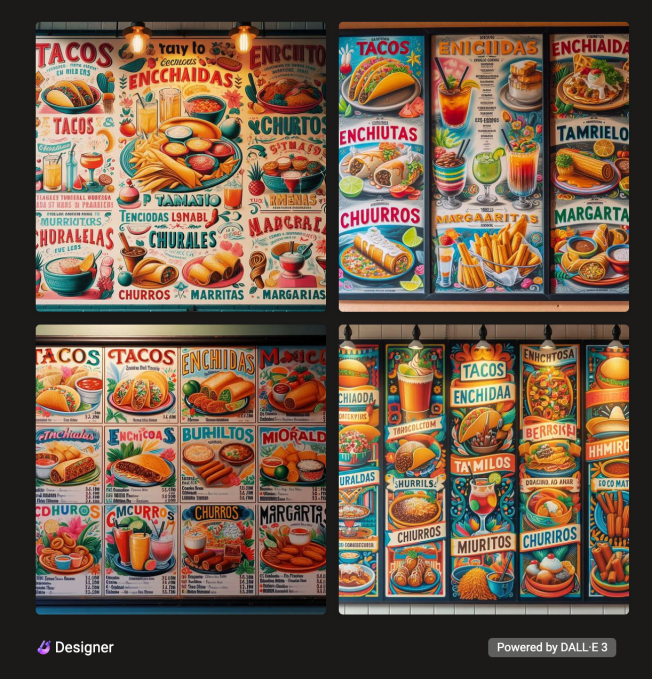

Il était autrefois facile de distinguer les images créées par des humains de celles générées par l’IA. Il y a seulement deux ans, il était impossible d’utiliser des modèles d’image pour créer un menu pour un restaurant mexicain sans inventer de nouvelles spécialités culinaires comme « enchuita », « churiros », « burrto » et « margartas ».

Désormais, lorsqu’on lui demande un menu de cuisine mexicaine, le nouveau modèle ChatGPT Images 2.0 d’OpenAI produit quelque chose qui pourrait être utilisé immédiatement dans un restaurant sans que les clients ne remarquent quoi que ce soit d’inhabituel. (Bien qu’un ceviche à 13,50 $ puisse susciter des questions sur le poisson.)

Crédits image : ChatGPT Images 2.0

À titre de comparaison, voici le résultat généré par DALL-E 3 il y a deux ans, lorsque ChatGPT ne prenait pas encore en charge la génération d’images :

Crédits image : Microsoft Designer (DALL-E 3)

Pourquoi les modèles d’images IA avaient du mal avec le texte

Les générateurs d’images IA ont historiquement eu des difficultés avec l’orthographe, car ils s’appuyaient généralement sur des modèles de diffusion, qui reconstruisent des images à partir de bruit.

« Les modèles de diffusion […] reconstruisent une entrée donnée », a déclaré Asmelash Teka Hadgu, fondateur et PDG de Lesan AI, à TechCrunch en 2024. « Nous pouvons supposer que les écrits sur une image constituent une très, très petite partie, donc le générateur d’images apprend les motifs qui couvrent le plus grand nombre de ces pixels. »

Depuis, les chercheurs ont exploré d’autres mécanismes de génération d’images, tels que les modèles autorégressifs, qui prédisent à quoi une image devrait ressembler et fonctionnent davantage comme les grands modèles de langage (LLM).

OpenAI a refusé de préciser lors d’un point presse quel type de modèle alimente ChatGPT Images 2.0.

Nouvelles capacités d’Images 2.0

OpenAI affirme que le nouveau modèle dispose de « capacités de réflexion », lui permettant de rechercher sur le web, de générer plusieurs images à partir d’une seule requête et de vérifier ses résultats. Cela permet à Images 2.0 de créer des supports marketing en différents formats et même des bandes dessinées à plusieurs cases.

L’entreprise indique également que le modèle comprend mieux le rendu de textes non latins dans des langues telles que le japonais, le coréen, l’hindi et le bengali. Sa date de coupure des connaissances est fixée à décembre 2025, ce qui peut influencer la précision de ses réponses aux requêtes portant sur des événements récents.

« Images 2.0 apporte un niveau de précision et de fidélité sans précédent à la création d’images. Il peut non seulement conceptualiser des images plus sophistiquées, mais il donne réellement vie à cette vision de manière efficace, capable de suivre des instructions, de préserver les détails demandés et de restituer les éléments fins qui mettent souvent en échec les modèles d’image : petits textes, iconographie, éléments d’interface utilisateur, compositions denses et contraintes stylistiques subtiles, le tout jusqu’à une résolution de 2K », a déclaré OpenAI dans un communiqué de presse.

Bien que la génération d’images ne soit pas aussi instantanée que la saisie d’une question dans ChatGPT, créer quelque chose de complexe comme une bande dessinée à plusieurs cases ne prend que quelques minutes.

Tous les utilisateurs de ChatGPT et de Codex auront accès à Images 2.0 à partir de mardi, les utilisateurs payants pouvant générer des résultats plus avancés. OpenAI mettra également à disposition l’API gpt-image-2, avec une tarification basée sur la qualité et la résolution des résultats.