OpenAI führt neue „Trusted Contact“-Sicherheitsfunktion für Fälle möglicher Selbstgefährdung ein

OpenAI hat in ChatGPT eine neue Funktion namens „Trusted Contact“ eingeführt, die Gespräche adressiert, in denen es um mögliche Selbstgefährdung gehen könnte. Die optionale Sicherheitsmaßnahme benachrichtigt eine festgelegte Kontaktperson, wenn OpenAI feststellt, dass für einen Nutzer ein ernsthaftes Sicherheitsrisiko bestehen könnte.

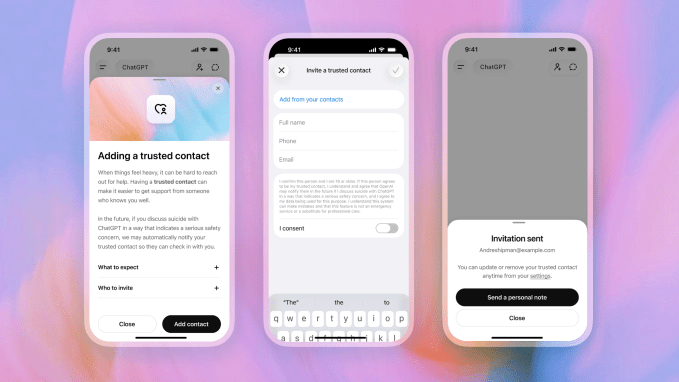

Am Donnerstag kündigte OpenAI eine neue Funktion namens Trusted Contact an, die darauf ausgelegt ist, eine vertrauenswürdige dritte Person zu benachrichtigen, wenn in einem Gespräch Hinweise auf Selbstverletzung geäußert werden. Die Funktion ermöglicht es einem erwachsenen ChatGPT-Nutzer, in seinem Konto eine andere Person – etwa einen Freund oder ein Familienmitglied – als vertrauenswürdigen Kontakt zu benennen.

Falls sich ein Gespräch in Richtung Selbstverletzung entwickelt, wird OpenAI den Nutzer dazu ermutigen, sich an diesen Kontakt zu wenden. Zudem wird eine automatische Benachrichtigung an die Kontaktperson gesendet, mit der Aufforderung, sich bei dem Nutzer zu melden.

Hintergrund und rechtlicher Druck

OpenAI sieht sich mit einer Welle von Klagen von Familien konfrontiert, deren Angehörige nach Gesprächen mit dem Chatbot Suizid begangen haben. In mehreren Fällen behaupten die Familien, dass ChatGPT ihre Angehörigen zum Suizid ermutigt oder ihnen sogar bei der Planung geholfen habe.

So funktioniert Trusted Contact

OpenAI nutzt derzeit eine Kombination aus Automatisierung und menschlicher Überprüfung, um potenziell schädliche Vorfälle zu behandeln. Bestimmte Gesprächsauslöser machen das System des Unternehmens auf suizidale Gedanken aufmerksam, woraufhin die Informationen an ein menschliches Sicherheitsteam weitergeleitet werden. Das Unternehmen gibt an, dass jede dieser Benachrichtigungen von einem Menschen überprüft wird.

„Wir bemühen uns, diese Sicherheitsbenachrichtigungen innerhalb von weniger als einer Stunde zu prüfen“, so das Unternehmen.

Wenn OpenAIs internes Team entscheidet, dass die Situation ein ernsthaftes Sicherheitsrisiko darstellt, sendet ChatGPT dem vertrauenswürdigen Kontakt eine Benachrichtigung – per E-Mail, SMS oder als In-App-Mitteilung. Die Benachrichtigung ist bewusst kurz gehalten und soll den Kontakt dazu ermutigen, sich bei der betreffenden Person zu melden. Sie enthält keine detaillierten Informationen über den Gesprächsinhalt, um die Privatsphäre des Nutzers zu schützen, so das Unternehmen.

Verwandte Schutzmaßnahmen und Einschränkungen

Die Funktion Trusted Contact folgt auf die Schutzmaßnahmen, die das Unternehmen im vergangenen September eingeführt hat und die Eltern eine Aufsicht über die Konten ihrer Jugendlichen ermöglichen, einschließlich des Erhalts von Sicherheitsbenachrichtigungen, wenn OpenAIs System der Ansicht ist, dass ihr Kind einem „ernsten Sicherheitsrisiko“ ausgesetzt ist. ChatGPT enthält außerdem automatische Hinweise, die Nutzer dazu ermutigen, professionelle Gesundheitsdienste in Anspruch zu nehmen, wenn sich ein Gespräch in Richtung Selbstverletzung entwickelt.

Trusted Contact ist optional, und selbst wenn die Funktion für ein bestimmtes Konto aktiviert ist, kann jeder Nutzer mehrere ChatGPT-Konten unterhalten. Auch OpenAIs Elternkontrollen sind optional und weisen eine ähnliche Einschränkung auf.

„Trusted Contact ist Teil von OpenAIs umfassenderem Bestreben, KI-Systeme zu entwickeln, die Menschen in schwierigen Momenten unterstützen“, schrieb das Unternehmen in seinem Ankündigungsbeitrag. „Wir werden weiterhin mit Klinikern, Forschern und politischen Entscheidungsträgern zusammenarbeiten, um zu verbessern, wie KI-Systeme reagieren, wenn Menschen sich möglicherweise in einer Notlage befinden.“