MiniMax spiega perché il suo modello M2 ha ‘dimenticato’ un nome: deriva dei token nel post-addestramento

MiniMax ha pubblicato un’analisi tecnica post-mortem che spiega perché il suo modello M2 non è riuscito a generare correttamente uno specifico nome cinese, attribuendo il problema alla degradazione dei token a bassa frequenza durante il post-addestramento. L’incidente evidenzia una sfida più ampia di affidabilità nei modelli linguistici di grandi dimensioni: una copertura disomogenea dei token può causare una deriva strutturale nello spazio degli embedding, influenzando nomi, lingue straniere e

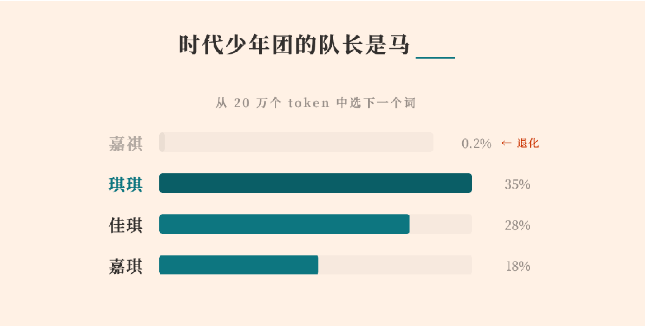

MiniMax ha pubblicato un rapporto tecnico dettagliato che spiega perché il suo modello linguistico di grandi dimensioni della serie M2 non è stato in grado di generare correttamente uno specifico nome cinese, “马嘉祺.” Quello che inizialmente sembrava un errore isolato di output si è trasformato in un caso di studio rivelatore su come le dinamiche di post-addestramento possano degradare silenziosamente i token a bassa frequenza nei large language model (LLM).

La causa principale: un token “compresso”

Secondo MiniMax, il problema ha avuto origine nel tokenizer del modello. Il nome “马嘉祺” è stato suddiviso in due token: “马” e “嘉祺.” Durante il pretraining, “嘉祺” compariva con frequenza sufficiente nei dati su scala web da essere unito in un token autonomo (ID 190467). Il modello ha appreso la sua rappresentazione come previsto.

Tuttavia, nella successiva fase di post-addestramento — in cui avvengono l’ottimizzazione tramite istruzioni e il perfezionamento del dialogo — il token “嘉祺” è apparso meno di cinque volte nel dataset curato di fine-tuning. Nel frattempo, token ad alta frequenza relativi alla sintassi del codice, ai marcatori di invocazione degli strumenti e ai modelli conversazionali comuni sono stati ripetutamente rinforzati.

Di conseguenza, l’embedding del token a bassa frequenza ha ricevuto quasi nessun aggiornamento di gradiente, mentre i token ad alta frequenza vicini hanno continuato a spostarsi nello spazio vettoriale. Nel tempo, ciò ha portato a quello che MiniMax descrive come “deriva” o “degenerazione” del token. Il modello conservava ancora la conoscenza sulla persona, ma ha perso la capacità di generare in modo affidabile il token corretto, producendo invece alternative foneticamente simili.

Un modello più ampio: linguaggio e degradazione dei token della “coda lunga”

MiniMax ha analizzato circa 200.000 token del vocabolario e ha rilevato che approssimativamente il 4,9% mostrava una degradazione significativa dopo il post-addestramento. Il problema era particolarmente grave per i token giapponesi, che presentavano un tasso di degradazione del 29,7%.

Ciò aiuta a spiegare anomalie osservate in precedenza, come risposte in giapponese che occasionalmente mescolavano caratteri russi o coreani. Quando determinati token linguistici sono sottorappresentati durante il fine-tuning, i loro embedding possono spostarsi verso regioni vicine nello spazio vettoriale, causando confusione tra lingue diverse.

La degradazione ha interessato anche simboli LaTeX, markup di Wikipedia e parole chiave SEO di bassa qualità che raramente compaiono nei dataset di instruction tuning. In sostanza, qualsiasi token privo di un’esposizione sufficiente durante il post-addestramento rischiava di essere “schiacciato” da token aggiornati più frequentemente.

Perché il post-addestramento crea un rischio strutturale

Il caso evidenzia una tensione strutturale nello sviluppo degli LLM. I tokenizer sono generalmente costruiti a partire da corpora di pretraining ampi e diversificati. Ma i dataset di post-addestramento — ottimizzati per utilità, sicurezza e qualità del dialogo — sono molto più ristretti nella distribuzione. Quando la copertura dei token diventa disomogenea, squilibri statistici possono accumularsi a livello di embedding.

Mentre il ragionamento ad alto livello e le capacità conversazionali del modello possono migliorare, la stabilità lessicale di basso livello può erodersi silenziosamente. L’incidente MiniMax dimostra che le sfide di affidabilità possono emergere non da lacune di conoscenza, ma da una deriva rappresentazionale a livello di token.

La strategia di mitigazione di MiniMax

Per affrontare il problema, MiniMax ha implementato tre misure correttive:

- Copertura sintetica dell’intero vocabolario: Il team ha generato compiti sintetici in stile “ripeti dopo di me” per garantire che ogni token del vocabolario riceva una frequenza minima di aggiornamenti durante il post-addestramento.

- Integrazione dei dati di pretraining: Parti del corpus originale a copertura ampia sono state integrate nella fase di fine-tuning supervisionato per contrastare l’oblio.

- Potatura e monitoraggio del vocabolario: I token raramente utilizzati o obsoleti possono essere rimossi, e le metriche di copertura dei token sono ora incluse nei controlli di qualità del post-addestramento.

Dopo queste correzioni, MiniMax riferisce che la confusione tra lingue nelle risposte in giapponese è scesa dal 47% all’1%, e che la stabilità complessiva dei token è migliorata in tutto il vocabolario.

Implicazioni per il settore

L’episodio mette in luce un problema di affidabilità poco discusso nei large language model: la copertura a livello di token durante il post-addestramento. Man mano che i modelli diventano sempre più specializzati attraverso l’instruction tuning e il reinforcement learning, mantenere un equilibrio statistico tra centinaia di migliaia di token diventa una sfida ingegneristica non banale.

Per gli sviluppatori di IA, la conclusione è chiara: migliorare l’allineamento semantico e le prestazioni sui compiti non può avvenire a scapito della stabilità lessicale. Metriche di copertura dei token, rilevamento della deriva degli embedding e strategie di fine-tuning bilanciate potrebbero diventare componenti critiche delle future pipeline di valutazione dei modelli.

Ciò che è iniziato come un modello che “dimentica” un nome rivela in definitiva una verità più profonda sulle dinamiche di addestramento degli LLM: negli spazi vettoriali ad alta dimensionalità, trascurare la coda lunga può rimodellare silenziosamente le fondamenta del sistema.